Processo di Gram-Schmidt

di Marco Taboga, PhD

Il processo (o procedura) di Gram-Schmidt è una sequenza di operazioni che permettono di trasformare un insieme di vettori linearmente indipendenti in un insieme di vettori ortonormali che coprono lo stesso spazio dell’insieme originale.

Preliminari

Rivediamo alcune nozioni che sono essenziali per comprendere il processo di Gram-Schmidt.

Ricordiamo che due vettori  e

e  si dicono ortogonali se e solo se il loro prodotto interno è uguale a zero, cioè

si dicono ortogonali se e solo se il loro prodotto interno è uguale a zero, cioè

Dato un prodotto interno, possiamo definire la norma (lunghezza) di un vettore  come segue:

come segue:

Un insieme di vettori è detto ortonormale se e solo se i suoi elementi hanno norma unitaria e sono ortogonali tra loro. In altre parole, un insieme di  vettori

vettori  è ortonormale se e solo se

è ortonormale se e solo se

Abbiamo dimostrato che i vettori di un insieme ortonormale sono linearmente indipendenti.

Quando una base per uno spazio vettoriale è anche un insieme ortonormale, si chiama base ortonormale.

Proiezioni su insiemi ortonormali

Nel processo di Gram-Schmidt, usiamo ripetutamente la prossima proposizione, che mostra che ogni vettore può essere decomposto in due parti: 1) la sua proiezione su un insieme ortonormale e 2) un residuo che è ortogonale all’insieme ortonormale dato.

Proposizione Sia  uno spazio vettoriale dotato di un prodotto interno

uno spazio vettoriale dotato di un prodotto interno  . Sia

. Sia  un insieme ortonormale. Per qualsiasi

un insieme ortonormale. Per qualsiasi  , abbiamo

, abbiamo dove

dove  è ortogonale a

è ortogonale a  per qualsiasi

per qualsiasi

Definizione Quindi, per ogni

Quindi, per ogni  , abbiamo che

, abbiamo che dove: nei passi

dove: nei passi  e

e  abbiamo usato il fatto che il prodotto interno è lineare nel suo primo argomento; nel passo

abbiamo usato il fatto che il prodotto interno è lineare nel suo primo argomento; nel passo  abbiamo usato il fatto che

abbiamo usato il fatto che  se

se  poiché abbiamo a che fare con un insieme ortonormale; nel passo

poiché abbiamo a che fare con un insieme ortonormale; nel passo  abbiamo usato il fatto che la norma di

abbiamo usato il fatto che la norma di  è uguale a 1. Pertanto,

è uguale a 1. Pertanto,  , come definito sopra, è ortogonale a tutti gli elementi dell’insieme ortonormale, il che dimostra la proposizione.

, come definito sopra, è ortogonale a tutti gli elementi dell’insieme ortonormale, il che dimostra la proposizione.

Il termine è chiamato la proiezione lineare di

è chiamato la proiezione lineare di  sull’insieme ortonormale

sull’insieme ortonormale  , mentre il termine

, mentre il termine  è chiamato il residuo della proiezione lineare.

è chiamato il residuo della proiezione lineare.

Normalizzazione

Un altro fatto forse ovvio che useremo ripetutamente nel processo di Gram-Schmidt è che, se prendiamo un qualsiasi vettore non nullo e lo dividiamo per la sua norma, allora il risultato della divisione è un nuovo vettore che ha norma unitaria.

In altre parole, se  allora, per la proprietà di definitezza della norma, abbiamo che

allora, per la proprietà di definitezza della norma, abbiamo che

Di conseguenza, possiamo definire e, per la positività e l’omogeneità assoluta della norma, abbiamo

e, per la positività e l’omogeneità assoluta della norma, abbiamo

Panoramica della procedura

Ora che sappiamo come normalizzare un vettore e come decomporlo in una proiezione su un insieme ortonormale e un residuo, siamo pronti per spiegare la procedura di Gram-Schmidt.

Daremo una panoramica del procedimento, dopo di che lo esprimeremo formalmente come una proposizione e discuteremo tutti i dettagli tecnici nella dimostrazione della proposizione.

Ecco la panoramica.

Ci viene dato un insieme di vettori linearmente indipendenti  .

.

Per iniziare il processo, normalizziamo il primo vettore, cioè definiamo

Nel secondo passo, proiettiamo  su

su  :

: dove

dove  è il residuo della proiezione.

è il residuo della proiezione.

Poi, normalizziamo il residuo:

Proveremo più tardi che  (in modo che la normalizzazione possa essere eseguita) perché i vettori di partenza sono linearmente indipendenti.

(in modo che la normalizzazione possa essere eseguita) perché i vettori di partenza sono linearmente indipendenti.

I due vettori  e

e  così ottenuti sono ortonormali.

così ottenuti sono ortonormali.

Nel terzo passo, proiettiamo  su

su  e

e  :

: e calcoliamo il residuo della proiezione

e calcoliamo il residuo della proiezione  .

.

Poi lo normalizziamo:

Procediamo in questo modo fino ad ottenere l’ultimo residuo normalizzato  .

.

Alla fine del processo, i vettori  formano un insieme ortonormale perché:

formano un insieme ortonormale perché:

-

sono il risultato di una normalizzazione, e di conseguenza hanno norma unitaria;

-

ogni

è ottenuto da un residuo che ha la proprietà di essere ortogonale a

è ottenuto da un residuo che ha la proprietà di essere ortogonale a  .

.

Per completare questa panoramica, ricordiamo che lo span lineare di  è l’insieme di tutti i vettori che possono essere scritti come combinazioni lineari di

è l’insieme di tutti i vettori che possono essere scritti come combinazioni lineari di  ; è indicato con

; è indicato con ed è uno spazio lineare.

ed è uno spazio lineare.

Poiché i vettori  sono combinazioni linearmente indipendenti di

sono combinazioni linearmente indipendenti di  , ogni vettore che può essere scritto come combinazione lineare di

, ogni vettore che può essere scritto come combinazione lineare di  può essere scritto anche come combinazione lineare di

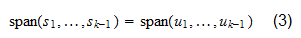

può essere scritto anche come combinazione lineare di  . Pertanto, gli span dei due insiemi di vettori coincidono:

. Pertanto, gli span dei due insiemi di vettori coincidono:

Affermazione formale

Formalizziamo qui il processo di Gram-Schmidt come una proposizione, la cui dimostrazione contiene tutti i dettagli tecnici della procedura.

Proposizione Sia  uno spazio vettoriale dotato di un prodotto interno

uno spazio vettoriale dotato di un prodotto interno  . Che

. Che  siano vettori linearmente indipendenti. Allora, esiste un insieme di vettori ortonormali

siano vettori linearmente indipendenti. Allora, esiste un insieme di vettori ortonormali  tale che

tale che per qualsiasi

per qualsiasi  .

.

La prova è per induzione: prima proviamo che la proposizione è vera per  , e poi proviamo che è vera per un generico

, e poi proviamo che è vera per un generico  se vale per

se vale per  . Quando

. Quando  , il vettore

, il vettore ha norma unitaria e costituisce da solo un insieme ortonormale: non ci sono altri vettori, quindi la condizione di ortogonalità è banalmente soddisfatta. L’insieme

ha norma unitaria e costituisce da solo un insieme ortonormale: non ci sono altri vettori, quindi la condizione di ortogonalità è banalmente soddisfatta. L’insieme è l’insieme di tutti i multipli scalari di

è l’insieme di tutti i multipli scalari di  , che sono anche multipli scalari di

, che sono anche multipli scalari di  (e viceversa). Quindi,

(e viceversa). Quindi,  Ora, supponiamo che la proposizione sia vera per

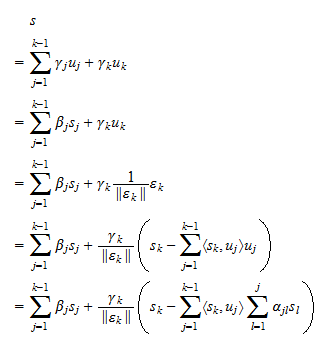

Ora, supponiamo che la proposizione sia vera per  . Allora, possiamo proiettare

. Allora, possiamo proiettare  su

su  :

: dove il residuo

dove il residuo  è ortogonale a

è ortogonale a  . Supponiamo che

. Supponiamo che  . Allora,

. Allora, Siccome, per ipotesi,

Siccome, per ipotesi,  per qualsiasi

per qualsiasi  , abbiamo che

, abbiamo che  per qualsiasi

per qualsiasi  , dove

, dove  sono scalari. Quindi,

sono scalari. Quindi, In altre parole, l’assunzione che

In altre parole, l’assunzione che  porta alla conclusione che

porta alla conclusione che  è una combinazione lineare di

è una combinazione lineare di  . Ma questo è impossibile perché una delle ipotesi della proposizione è che

. Ma questo è impossibile perché una delle ipotesi della proposizione è che  siano linearmente indipendenti. Di conseguenza, deve essere che

siano linearmente indipendenti. Di conseguenza, deve essere che  . Possiamo quindi normalizzare il residuo e definire il vettore

. Possiamo quindi normalizzare il residuo e definire il vettore che ha norma unitaria. Sappiamo già che

che ha norma unitaria. Sappiamo già che  è ortogonale a

è ortogonale a  . Questo implica che anche

. Questo implica che anche  è ortogonale a

è ortogonale a  . Quindi,

. Quindi,  è un insieme ortonormale. Ora, prendiamo un qualsiasi vettore

è un insieme ortonormale. Ora, prendiamo un qualsiasi vettore  che può essere scritto come

che può essere scritto come dove

dove  sono scalari. Poiché, per ipotesi,

sono scalari. Poiché, per ipotesi,  abbiamo che l’equazione (2) può anche essere scritta come

abbiamo che l’equazione (2) può anche essere scritta come dove

dove  sono scalari, e: nel passo

sono scalari, e: nel passo  abbiamo usato l’equazione (1); nel passo

abbiamo usato l’equazione (1); nel passo  abbiamo usato la definizione di

abbiamo usato la definizione di  . Così, abbiamo dimostrato che ogni vettore che può essere scritto come una combinazione lineare di

. Così, abbiamo dimostrato che ogni vettore che può essere scritto come una combinazione lineare di  può anche essere scritto come una combinazione lineare di

può anche essere scritto come una combinazione lineare di  . L’ipotesi (3) permette di provare il contrario in modo del tutto analogo:

. L’ipotesi (3) permette di provare il contrario in modo del tutto analogo: In altre parole, ogni combinazione lineare di

In altre parole, ogni combinazione lineare di  è anche una combinazione lineare di

è anche una combinazione lineare di  . Questo dimostra che

. Questo dimostra che  e conclude la dimostrazione.

e conclude la dimostrazione.

Ogni spazio a prodotto interno ha una base ortonormale

La seguente proposizione presenta un’importante conseguenza del processo di Gram-Schmidt.

Proposizione Sia  uno spazio vettoriale dotato di un prodotto interno

uno spazio vettoriale dotato di un prodotto interno  . Se

. Se  ha dimensione finita

ha dimensione finita  , allora esiste una base ortonormale

, allora esiste una base ortonormale  per

per  .

.

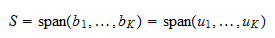

Siccome  è a dimensione finita, esiste almeno una base per

è a dimensione finita, esiste almeno una base per  , costituita da

, costituita da  vettori

vettori  . Possiamo applicare la procedura di Gram-Schmidt alla base e ottenere un insieme ortonormale

. Possiamo applicare la procedura di Gram-Schmidt alla base e ottenere un insieme ortonormale  . Poiché

. Poiché  è una base, essa si estende su

è una base, essa si estende su  . Pertanto,

. Pertanto,  Quindi,

Quindi,  è una base ortonormale di

è una base ortonormale di  .

.

Esercizi risolti

Di seguito puoi trovare alcuni esercizi con soluzioni spiegate.

Esercizio 1

Consideriamo lo spazio  di tutti i

di tutti i  vettori aventi entrate reali e il prodotto interno

vettori aventi entrate reali e il prodotto interno dove

dove  e

e  è la trasposizione di

è la trasposizione di  . Definire il vettore

. Definire il vettore

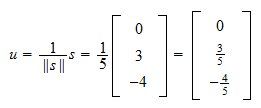

Normalizzare  .

.

La norma di  è

è Quindi, la normalizzazione di

Quindi, la normalizzazione di  è

è

Esercizio 2

Consideriamo lo spazio  di tutti i

di tutti i  vettori con entrate reali e il prodotto interno

vettori con entrate reali e il prodotto interno dove

dove  . Consideriamo i due vettori linearmente indipendenti

. Consideriamo i due vettori linearmente indipendenti

Trasformarli in un insieme ortonormale utilizzando il processo di Gram-Schmidt.

La norma di  è

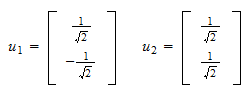

è  Quindi, il primo vettore ortonormale è

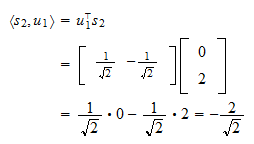

Quindi, il primo vettore ortonormale è Il prodotto interno di

Il prodotto interno di  e

e  è

è La proiezione di

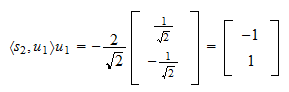

La proiezione di  su

su  è

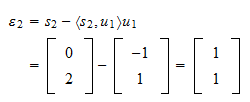

è Il residuo della proiezione è

Il residuo della proiezione è La norma del residuo è

La norma del residuo è e il residuo normalizzato è

e il residuo normalizzato è Quindi, l’insieme ortonormale che stavamo cercando è

Quindi, l’insieme ortonormale che stavamo cercando è

Come citare

Cita come:

Taboga, Marco (2017). “Processo di Gram-Schmidt”, Lezioni di algebra matriciale. https://www.statlect.com/matrix-algebra/Gram-Schmidt-process.

Leave a Reply