Processus de Gram-Schmidt

par Marco Taboga, PhD

Le processus (ou procédure) de Gram-Schmidt est une séquence d’opérations qui permettent de transformer un ensemble de vecteurs linéairement indépendants en un ensemble de vecteurs orthonormés qui couvrent le même espace que l’ensemble original.

Préliminaires

Passons en revue quelques notions indispensables à la compréhension du procédé de Gram-Schmidt.

Rappelons que deux vecteurs  et

et  sont dits orthogonaux si et seulement si leur produit interne est égal à zéro, c’est-à-dire,

sont dits orthogonaux si et seulement si leur produit interne est égal à zéro, c’est-à-dire,

Étant donné un produit interne, nous pouvons définir la norme (longueur) d’un vecteur  comme suit :

comme suit :

Un ensemble de vecteurs est dit orthonormé si et seulement si ses éléments ont une norme unitaire et sont orthogonaux entre eux. En d’autres termes, un ensemble de  vecteurs

vecteurs  est orthonormé si et seulement si

est orthonormé si et seulement si

Nous avons prouvé que les vecteurs d’un ensemble orthonormé sont linéairement indépendants.

Lorsqu’une base pour un espace vectoriel est aussi un ensemble orthonormé, on l’appelle une base orthonormée.

Projections sur des ensembles orthonormés

Dans le processus de Gram-Schmidt, nous utilisons de manière répétée la proposition suivante, qui montre que tout vecteur peut être décomposé en deux parties : 1) sa projection sur un ensemble orthonormé et 2) un résidu qui est orthogonal à l’ensemble orthonormé donné.

Proposition Soit  un espace vectoriel équipé d’un produit interne

un espace vectoriel équipé d’un produit interne  . Soit

. Soit  un ensemble orthonormé. Pour tout

un ensemble orthonormé. Pour tout  , on a

, on a où

où  est orthogonal à

est orthogonal à  pour tout

pour tout

Define Alors, pour chaque

Alors, pour chaque  , on a que

, on a que où : dans les étapes

où : dans les étapes  et

et  nous avons utilisé le fait que le produit interne est linéaire en son premier argument ; à l’étape

nous avons utilisé le fait que le produit interne est linéaire en son premier argument ; à l’étape  nous avons utilisé le fait que

nous avons utilisé le fait que  si

si  puisque nous avons affaire à un ensemble orthonormé ; à l’étape

puisque nous avons affaire à un ensemble orthonormé ; à l’étape  nous avons utilisé le fait que la norme de

nous avons utilisé le fait que la norme de  est égale à 1. Donc,

est égale à 1. Donc,  , tel que défini ci-dessus, est orthogonal à tous les éléments de l’ensemble orthonormé, ce qui prouve la proposition.

, tel que défini ci-dessus, est orthogonal à tous les éléments de l’ensemble orthonormé, ce qui prouve la proposition.

Le terme est appelé la projection linéaire de

est appelé la projection linéaire de  sur l’ensemble orthonormé

sur l’ensemble orthonormé  , tandis que le terme

, tandis que le terme  est appelé le résidu de la projection linéaire.

est appelé le résidu de la projection linéaire.

Normalisation

Un autre fait peut-être évident que nous allons utiliser à plusieurs reprises dans le processus de Gram-Schmidt est que, si nous prenons un vecteur non nul quelconque et que nous le divisons par sa norme, alors le résultat de la division est un nouveau vecteur qui a une norme unitaire.

En d’autres termes, si  alors, par la propriété de définitude de la norme, nous avons que

alors, par la propriété de définitude de la norme, nous avons que

En conséquence, nous pouvons définir et, par la positivité et l’homogénéité absolue de la norme, on a

et, par la positivité et l’homogénéité absolue de la norme, on a

Overview de la procédure

Maintenant que nous savons comment normaliser un vecteur et comment le décomposer en une projection sur un ensemble orthonormé et un résidu, nous sommes prêts à expliquer la procédure de Gram-Schmidt.

Nous allons donner un aperçu du processus, après quoi nous l’exprimerons formellement comme une proposition et nous discuterons de tous les détails techniques dans la preuve de la proposition.

Voici l’aperçu.

On nous donne un ensemble de vecteurs linéairement indépendants  .

.

Pour commencer le processus, on normalise le premier vecteur, c’est-à-dire qu’on définit

Dans un deuxième temps, on projette  sur

sur  :

: où

où  est le résidu de la projection.

est le résidu de la projection.

Ensuite, on normalise le résidu :

On prouvera plus tard que  (pour que la normalisation puisse être effectuée) car les vecteurs de départ sont linéairement indépendants.

(pour que la normalisation puisse être effectuée) car les vecteurs de départ sont linéairement indépendants.

Les deux vecteurs  et

et  ainsi obtenus sont orthonormés.

ainsi obtenus sont orthonormés.

Dans la troisième étape, on projette  sur

sur  et

et  :

: et on calcule le résidu de la projection

et on calcule le résidu de la projection  .

.

On le normalise ensuite :

On procède ainsi jusqu’à obtenir le dernier résidu normalisé  .

.

A la fin du processus, les vecteurs  forment un ensemble orthonormé car :

forment un ensemble orthonormé car :

-

ils sont le résultat d’une normalisation, et par conséquent ils ont une norme unitaire ;

-

chaque

est obtenu à partir d’un résidu qui a la propriété d’être orthogonal à

est obtenu à partir d’un résidu qui a la propriété d’être orthogonal à  .

.

Pour compléter cet aperçu, rappelons que l’étendue linéaire de  est l’ensemble de tous les vecteurs qui peuvent s’écrire comme des combinaisons linéaires de

est l’ensemble de tous les vecteurs qui peuvent s’écrire comme des combinaisons linéaires de  ; elle est notée par

; elle est notée par et c’est un espace linéaire.

et c’est un espace linéaire.

Puisque les vecteurs  sont des combinaisons linéairement indépendantes de

sont des combinaisons linéairement indépendantes de  , tout vecteur qui peut s’écrire comme une combinaison linéaire de

, tout vecteur qui peut s’écrire comme une combinaison linéaire de  peut aussi s’écrire comme une combinaison linéaire de

peut aussi s’écrire comme une combinaison linéaire de  . Par conséquent, les étendues des deux ensembles de vecteurs coïncident:

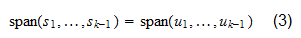

. Par conséquent, les étendues des deux ensembles de vecteurs coïncident:

Énoncé formel

Nous formalisons ici le processus de Gram-Schmidt sous la forme d’une proposition, dont la preuve contient tous les détails techniques de la procédure.

Proposition Soit  un espace vectoriel équipé d’un produit interne

un espace vectoriel équipé d’un produit interne  . Soit

. Soit  des vecteurs linéairement indépendants. Alors, il existe un ensemble de vecteurs orthonormaux

des vecteurs linéairement indépendants. Alors, il existe un ensemble de vecteurs orthonormaux  tel que

tel que pour tout

pour tout  .

.

La preuve se fait par induction : on prouve d’abord que la proposition est vraie pour  , puis on prouve qu’elle est vraie pour un

, puis on prouve qu’elle est vraie pour un  générique si elle vaut pour

générique si elle vaut pour  . Lorsque

. Lorsque  , le vecteur

, le vecteur a la norme unitaire et il constitue à lui seul un ensemble orthonormé : il n’y a pas d’autres vecteurs, donc la condition d’orthogonalité est trivialement satisfaite. L’ensemble

a la norme unitaire et il constitue à lui seul un ensemble orthonormé : il n’y a pas d’autres vecteurs, donc la condition d’orthogonalité est trivialement satisfaite. L’ensemble est l’ensemble de tous les multiples scalaires de

est l’ensemble de tous les multiples scalaires de  , qui sont aussi des multiples scalaires de

, qui sont aussi des multiples scalaires de  (et vice versa). Par conséquent,

(et vice versa). Par conséquent,  Maintenant, supposons que la proposition soit vraie pour

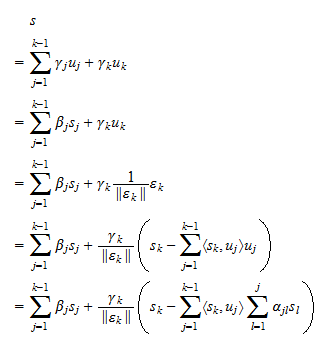

Maintenant, supposons que la proposition soit vraie pour  . Alors, on peut projeter

. Alors, on peut projeter  sur

sur  :

: où le résidu

où le résidu  est orthogonal à

est orthogonal à  . Supposons que

. Supposons que  . Alors,

. Alors, Puisque, par hypothèse,

Puisque, par hypothèse,  pour tout

pour tout  , on a que

, on a que  pour tout

pour tout  , où

, où  sont des scalaires. Donc,

sont des scalaires. Donc, En d’autres termes, l’hypothèse que

En d’autres termes, l’hypothèse que  conduit à la conclusion que

conduit à la conclusion que  est une combinaison linéaire de

est une combinaison linéaire de  . Mais c’est impossible car l’une des hypothèses de la proposition est que

. Mais c’est impossible car l’une des hypothèses de la proposition est que  sont linéairement indépendants. En conséquence, il faut que

sont linéairement indépendants. En conséquence, il faut que  . Nous pouvons donc normaliser le résidu et définir le vecteur

. Nous pouvons donc normaliser le résidu et définir le vecteur qui a une norme unitaire. Nous savons déjà que

qui a une norme unitaire. Nous savons déjà que  est orthogonal à

est orthogonal à  . Cela implique que également

. Cela implique que également  est orthogonal à

est orthogonal à  . Ainsi,

. Ainsi,  est un ensemble orthonormé. Maintenant, prenons un vecteur quelconque

est un ensemble orthonormé. Maintenant, prenons un vecteur quelconque  qui peut être écrit sous la forme

qui peut être écrit sous la forme où

où  sont des scalaires. Puisque, par hypothèse,

sont des scalaires. Puisque, par hypothèse,  nous avons que l’équation (2) peut aussi s’écrire sous la forme

nous avons que l’équation (2) peut aussi s’écrire sous la forme où

où  sont des scalaires, et : à l’étape

sont des scalaires, et : à l’étape  nous avons utilisé l’équation (1) ; à l’étape

nous avons utilisé l’équation (1) ; à l’étape  nous avons utilisé la définition de

nous avons utilisé la définition de  . Ainsi, nous avons prouvé que tout vecteur qui peut être écrit comme une combinaison linéaire de

. Ainsi, nous avons prouvé que tout vecteur qui peut être écrit comme une combinaison linéaire de  peut aussi être écrit comme une combinaison linéaire de

peut aussi être écrit comme une combinaison linéaire de  . L’hypothèse (3) permet de prouver la réciproque de manière tout à fait analogue :

. L’hypothèse (3) permet de prouver la réciproque de manière tout à fait analogue : En d’autres termes, toute combinaison linéaire de

En d’autres termes, toute combinaison linéaire de  est aussi une combinaison linéaire de

est aussi une combinaison linéaire de  . Ceci prouve que

. Ceci prouve que  et conclut la preuve.

et conclut la preuve.

Tout espace de produit interne a une base orthonormée

La proposition suivante présente une conséquence importante du procédé de Gram-Schmidt.

Proposition Soit  un espace vectoriel muni d’un produit interne

un espace vectoriel muni d’un produit interne  . Si

. Si  a une dimension finie

a une dimension finie  , alors il existe une base orthonormée

, alors il existe une base orthonormée  pour

pour  .

.

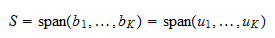

Puisque  est de dimension finie, il existe au moins une base pour

est de dimension finie, il existe au moins une base pour  , constituée de

, constituée de  vecteurs

vecteurs  . On peut appliquer la procédure de Gram-Schmidt à cette base et obtenir un ensemble orthonormé

. On peut appliquer la procédure de Gram-Schmidt à cette base et obtenir un ensemble orthonormé  . Puisque

. Puisque  est une base, elle s’étend sur

est une base, elle s’étend sur  . Par conséquent,

. Par conséquent,  Donc,

Donc,  est une base orthonormée de

est une base orthonormée de  .

.

Exercices résolus

Vous trouverez ci-dessous quelques exercices avec des solutions expliquées.

Exercice 1

Considérons l’espace  de tous les

de tous les  vecteurs ayant des entrées réelles et le produit interne

vecteurs ayant des entrées réelles et le produit interne où

où  et

et  est la transposition de

est la transposition de  . Définir le vecteur

. Définir le vecteur

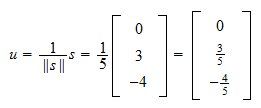

Normaliser  .

.

La norme de  est

est Donc, la normalisation de

Donc, la normalisation de  est

est

Exercice 2

Considérons l’espace  de tous les

de tous les  vecteurs ayant des entrées réelles et le produit interne

vecteurs ayant des entrées réelles et le produit interne où

où  . Considérons les deux vecteurs linéairement indépendants

. Considérons les deux vecteurs linéairement indépendants

Transformons-les en un ensemble orthonormé en utilisant le procédé de Gram-Schmidt.

La norme de  est

est  Donc, le premier vecteur orthonormé est

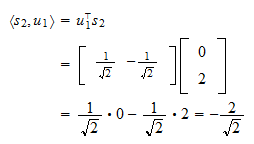

Donc, le premier vecteur orthonormé est Le produit interne de

Le produit interne de  et

et  est

est La projection de

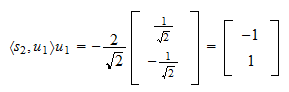

La projection de  sur

sur  est

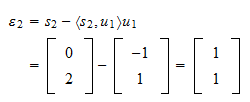

est Le résidu de la projection est

Le résidu de la projection est La norme du résidu est

La norme du résidu est et le résidu normalisé est

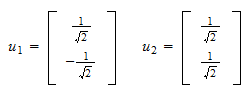

et le résidu normalisé est Donc, l’ensemble orthonormal que nous recherchions est

Donc, l’ensemble orthonormal que nous recherchions est

Comment citer

Veuillez citer comme :

Taboga, Marco (2017). » Processus de Gram-Schmidt « , Lectures on matrix algebra. https://www.statlect.com/matrix-algebra/Gram-Schmidt-process.

Leave a Reply